大數據開發 以Hadoop為基石的技術生態與實踐

在當今信息爆炸的時代,大數據已從技術概念演變為驅動商業決策與科技創新的核心引擎。大數據開發,作為將海量、高速、多樣的數據轉化為價值的關鍵過程,其技術棧正日益豐富和成熟。而談及大數據技術,Hadoop無疑是一座繞不開的里程碑,它奠定了分布式處理海量數據的理論基礎與工程實踐框架。

Hadoop:大數據處理的基石

Hadoop的核心設計思想源自Google的MapReduce和GFS論文,其核心組件包括:

- HDFS (Hadoop Distributed File System):一個高容錯、高吞吐量的分布式文件系統,專為存儲超大規模數據集而設計。它將文件分割成塊,并分布式地存儲在多臺廉價服務器上,實現了數據的可靠存儲與并行訪問。

- MapReduce:一種編程模型,用于并行處理大規模數據集。它將計算任務分為兩個階段——“Map”(映射)階段對數據進行過濾和排序,“Reduce”(歸約)階段對Map結果進行匯總。這種模型將計算任務分發到數據所在的節點,遵循“移動計算而非數據”的原則,極大地減少了網絡傳輸開銷。

正是HDFS與MapReduce的結合,使得企業能夠利用普通的商用硬件集群來經濟高效地處理PB乃至EB級的數據,解決了傳統架構在可擴展性和成本上的瓶頸。

圍繞Hadoop演進的豐富技術生態

隨著應用場景的深化,Hadoop生態圈蓬勃發展,涌現出眾多互補和增強的技術:

- 數據管理與計算引擎:

- Hive:基于Hadoop的數據倉庫工具,提供類SQL(HQL)的查詢功能,將復雜的MapReduce程序簡化為熟悉的SQL語句,極大降低了數據分析的門檻。

- Spark:一個更快、更通用的集群計算系統。它通過內存計算和優化的執行引擎,在迭代計算和交互式查詢上性能遠超MapReduce,并提供了流處理(Spark Streaming)、圖計算(GraphX)、機器學習(MLlib)等豐富庫。

- Flink:主打流處理的下一代計算引擎,以其高吞吐、低延遲、精確一次(exactly-once)的狀態一致性保證,在實時數據處理領域占據重要地位。

- 資源調度與管理:

- YARN (Yet Another Resource Negotiator):Hadoop 2.0引入的核心組件,它將資源管理與作業調度/監控分離,使Hadoop能夠支持多種計算框架(如MapReduce, Spark, Flink)在同一個集群上運行,提高了集群利用率和多租戶支持能力。

- 數據采集與傳輸:

- Flume:一個高可用的分布式海量日志采集、聚合和傳輸系統。

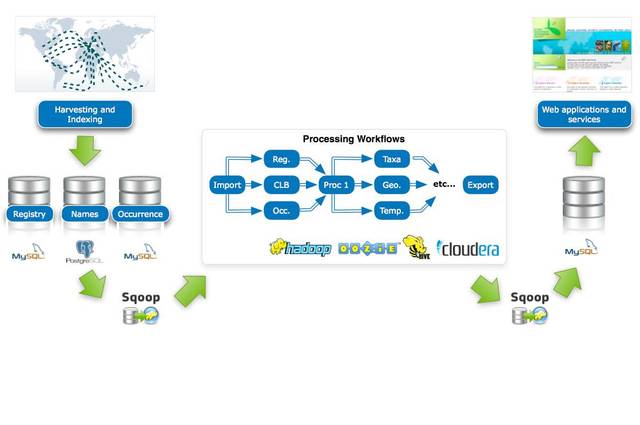

- Sqoop:用于在Hadoop和結構化數據存儲(如關系型數據庫)之間高效傳輸批量數據的工具。

- 協調與服務:

- ZooKeeper:一個分布式的、開放源碼的分布式應用程序協調服務,提供配置維護、命名服務、分布式同步、組服務等,是許多大數據組件穩定運行的基礎。

- 列式存儲與查詢:

- HBase:構建在HDFS之上的分布式、面向列的NoSQL數據庫,適合實時讀寫和隨機訪問超大規模稀疏數據集。

大數據開發的核心工作與技能要求

一名大數據開發工程師的工作遠不止于使用Hadoop。其核心職責通常包括:

- 數據管道構建:設計與開發穩定、高效的數據采集、清洗、轉換、加載(ETL/ELT)流程,確保數據從源頭到數據倉庫/湖的順暢流動。

- 數據倉庫/湖建模:根據業務需求設計數據模型(如維度建模),構建層次清晰、易于訪問和分析的數據體系。

- 計算任務開發:使用Spark、Flink等引擎編寫復雜的批處理或流處理作業,實現業務邏輯,如用戶畫像、實時風控、推薦算法等。

- 性能優化:對數據傾斜、Shuffle過程、存儲格式(如Parquet、ORC)、資源分配等進行調優,以提升任務執行效率和降低集群成本。

- 平臺運維與監控:保障集群及各項服務的穩定運行,處理故障,并建立完善的監控告警體系。

所需的技能棧通常涵蓋:扎實的Java/Scala/Python編程基礎、對Hadoop生態各組件的深入理解、熟練使用Spark/Flink進行開發、熟悉Linux環境與Shell腳本、了解一種或多種SQL/NoSQL數據庫,并具備良好的數據結構和算法基礎。

與展望

Hadoop開啟了大數據的工業化時代,但其生態已從單一的批處理范式,演進為批流一體、實時智能的融合架構。今天的大數據開發,是Hadoop基石與其繁榮生態共同編織的復雜畫卷。隨著云原生、數據湖倉一體(Lakehouse)、人工智能與機器學習更深度地融合,大數據開發的技術邊界將持續拓展,但其核心目標始終如一:從數據的礦山中,更智能、更高效地提煉出洞察與價值。

如若轉載,請注明出處:http://m.w8w.org.cn/product/275.html

更新時間:2026-04-18 18:26:17